A verdadeira barreira para implementar agentes de IA on-chain não reside na capacidade do modelo, mas sim na camada de coordenação fiável.

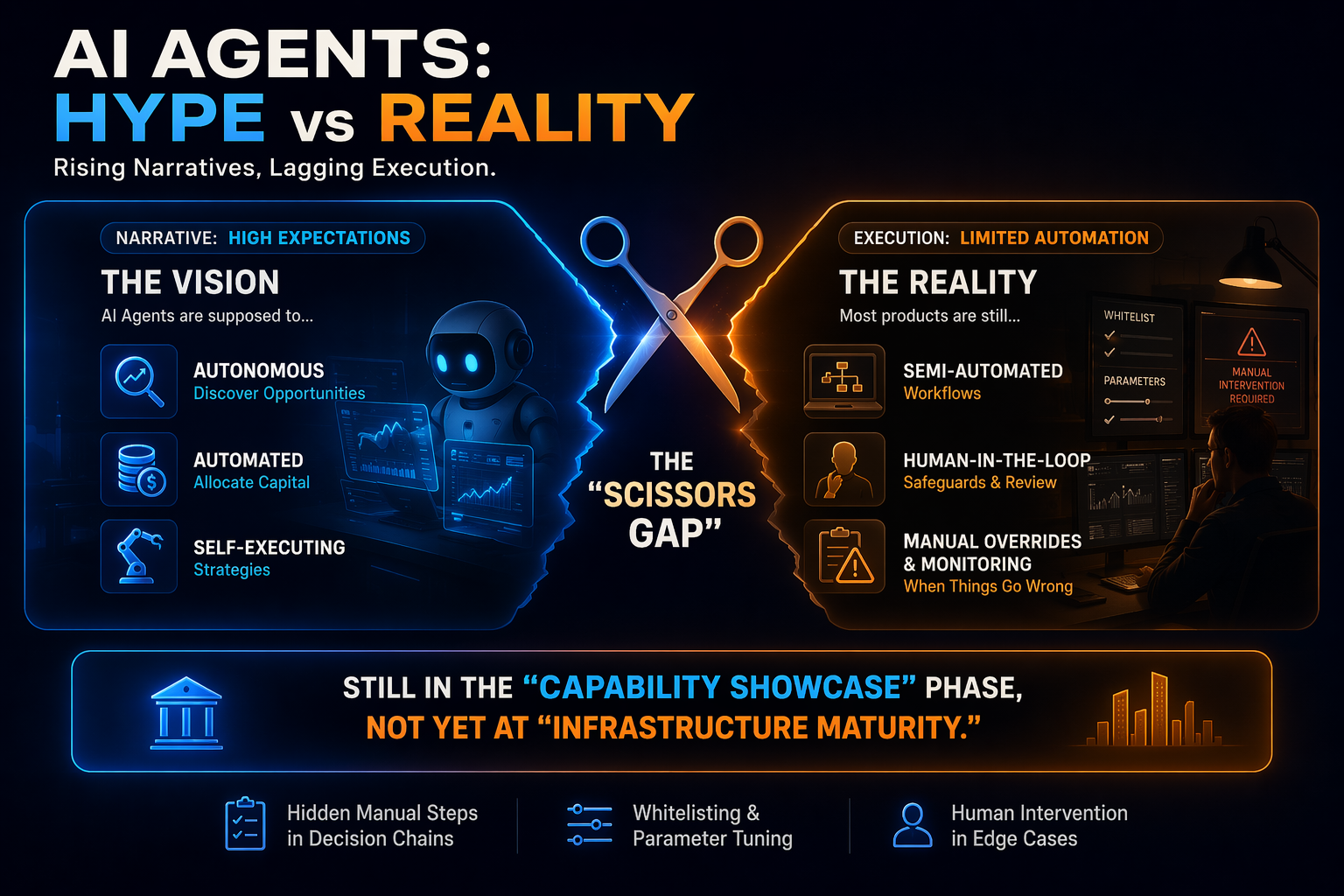

Fenómeno: As narrativas sobre agentes estão a intensificar-se, mas a eficiência de implementação não acompanha

No mercado atual, está a emergir uma clara “diferença de tesoura”:

-

No plano narrativo, os agentes são projetados para “descobrir oportunidades automaticamente, alocar fundos automaticamente e executar estratégias automaticamente”.

-

Na execução, a maioria dos produtos permanece em “fluxos de trabalho semi-automatizados com intervenção manual”.

Isto revela que o setor ainda se encontra na “fase de demonstração de capacidades”, sem ter transitado para a “fase de formação de infraestruturas”.

Apesar de muitos produtos aparentarem automação, a tomada de decisão central continua dependente de pré-julgamento manual — como filtragem de whitelist, manutenção de parâmetros de estratégia e intervenção manual em situações anómalas.

Equívoco: O problema central não é a fraqueza do modelo, mas a ausência de coordenação sistémica

É frequente justificar os desafios de implementação com “o modelo não é suficientemente inteligente”. Contudo, isto resolve apenas parte do problema. O constrangimento fundamental é que, independentemente da capacidade do modelo, é imprescindível um sistema operativo funcional.

Para que os agentes on-chain completem tarefas, é necessário superar pelo menos quatro obstáculos:

-

Identificar alvos interativos;

-

Confirmar que os alvos são autênticos e fiáveis;

-

Compreender o significado económico desses alvos;

-

Executar sob restrições de risco e verificar resultados.

O desafio atual reside no suporte limitado da infraestrutura on-chain para os três primeiros passos. Em suma, o problema não é “colocar ordens”, mas sim “existir um sistema upstream fiável de cognição e restrição”.

Quatro fricções centrais: descoberta, crédito, dados, execução

Fricção de descoberta: o mundo aberto é vasto, mas as oportunidades relevantes são escassas

As redes permissionless permitem a qualquer pessoa implementar contratos. Para um agente, protocolos legítimos, contratos de testnet, forks maliciosos e projetos shell são quase indistinguíveis em termos de descoberta. “Ver um contrato” não equivale a “ver uma oportunidade” e, muito menos, a “ver uma oportunidade executável”.

Os sistemas quant tradicionais operam em conjuntos fechados, dado que os limites da estratégia estão pré-definidos.

Para que os agentes descubram oportunidades dinamicamente em runtime, é necessário suportar o custo extra de “julgamento de relevância” — a essência da fricção de descoberta.

Fricção de crédito: os endereços on-chain são verificáveis, a identidade económica não

As Blockchain conseguem verificar assinaturas e alterações de estado, mas não garantem “implementação oficial” ou “token como ativo padrão de mercado”. Na prática, os julgamentos de crédito dependem de frontends, documentação, reputação social e consenso do ecossistema. Para humanos, isto funciona como um sistema baseado na experiência; para agentes, é um campo em falta.

Como consequência, os agentes enfrentam dois cenários de alto risco na camada de crédito:

-

Interação com endereços incorretos, tokens falsos ou afiliados anómalos;

-

Operação contínua sob pressupostos desatualizados após mudanças de governança ou permissões.

Erros deste tipo em sistemas de capital não são meras discrepâncias — são fontes diretas de perdas de capital.

Fricção de dados: ter dados não implica ter dados acionáveis

Os dados on-chain são abundantes, mas a semântica económica não está normalizada. Mesmo nos mercados de empréstimos, diferentes protocolos utilizam estruturas de interface, campos de estado, unidades e frequências de atualização distintas.

Para que os agentes comparem entre protocolos, é necessário reconstruir extensivamente a semântica:

-

Que campo representa a liquidez efetivamente disponível;

-

Que parâmetro impacta o fator de saúde;

-

Que taxa de juros reflete o retorno realizável, não apenas a exibição nominal.

Sem uma camada semântica normalizada, os agentes gastam muitos recursos em “montagem de dados”, resultando em menor pontualidade e precisão na tomada de decisão.

Fricção de execução: uma negociação bem-sucedida não equivale a concluir a tarefa

Um equívoco comum na execução on-chain é considerar “negociar on-chain” como “objetivo alcançado”. Na realidade, as tarefas dos agentes são frequentemente processos multi-etapas:

Aprovação -> Roteamento -> Swap -> Depósito -> Rebalanceamento -> Verificação de risco.

Qualquer derrapagem, atraso, alteração de liquidez ou drift de estado pode provocar divergência entre o resultado final e o objetivo pretendido.

A camada de execução necessita, portanto, de “restrições de estratégia e verificação pós-execução”, e não apenas de “transmissão de uma transação”.

Porque é que a fricção será ainda mais acentuada em 2026

O que distingue 2026 é a rápida evolução dos agentes de “ferramentas de informação” para “executores de capital”.

À medida que as permissões passam de “leitura” para “escrita”, o risco passa de “responder incorretamente a perguntas” para “alocar fundos de forma errada”.

Além disso, três tendências do setor amplificam o problema:

-

Ambientes multi-cadeia e entre cadeias estão cada vez mais complexos, com interfaces cada vez mais heterogéneas;

-

A inovação de protocolos acelera, mas a normalização não acompanha;

-

As expectativas de mercado para a comercialização de agentes aumentam, enquanto a tolerância ao erro diminui.

O resultado: quanto mais intensa a narrativa, mais rapidamente surgem as insuficiências da infraestrutura.

Que cenários vão chegar primeiro e quais permanecem de alto risco

Cenários mais propensos a serem implementados primeiro

-

Rebalanceamento de fundos em protocolos whitelist;

-

Gestão de tesouraria em cadeias únicas, poucos protocolos e negociações de baixa frequência;

-

Tarefas automatizadas de pagamento e liquidação com objetivos e limites bem definidos.

Estes cenários apresentam limites ambientais claros, espaços de exceção controláveis e responsabilidades bem delineadas.

Cenários que permanecem de alto risco

-

Arbitragem de alta frequência entre cadeias e descoberta dinâmica de protocolos desconhecidos;

-

Alocação autónoma em todo o mercado sem restrições de whitelist;

-

Mudança de estratégia totalmente automatizada em ambientes de alta alavancagem e baixa liquidez.

Estes cenários não estão excluídos para sempre, mas atualmente os “pré-requisitos de infraestrutura fundamental” ainda não foram implementados.

Um caminho mais realista para a implementação: limitar primeiro, expandir depois

O caminho mais viável para a adoção de agentes on-chain não passa por autonomia total imediata, mas por uma abordagem faseada.

Fase 1: camada de objetos fiáveis

Primeiro, abordar “com quem interagir”:

-

Registos padronizados de endereços;

-

Provas de autenticidade de tokens e protocolos;

-

Monitorização em tempo real de contratos upgradáveis e alterações de permissões.

Fase 2: camada de dados semânticos

Depois, abordar “o que compreender”:

-

Modelos unificados de objetos económicos entre protocolos;

-

Parâmetros de risco padronizados;

-

Indexação de dados rastreável, de baixa latência e instantâneos.

Fase 3: camada de execução limitada

Em seguida, abordar “como atuar”:

-

Motores de expressão de intenção e restrição de estratégia;

-

Orquestração de execução multi-etapas e rollbacks de falhas;

-

Simulação pré-negociação e verificação de resultados pós-negociação.

Fase 4: camada de responsabilidade e governança

Por fim, abordar “o que fazer quando algo corre mal”:

-

Graduação de permissões e mecanismos de circuit breaker;

-

Auditoria operacional e atribuição de responsabilidades;

-

Procedimentos colaborativos de tomada humano-máquina.

Só ao construir progressivamente estas quatro camadas é possível que os agentes evoluam de “demonstração” para “delegação fiável”.

Conclusão: o sucesso dos agentes on-chain depende de infraestrutura de execução fiável

Os agentes IA são difíceis de implementar on-chain não porque as Blockchain não conseguem executar ou os modelos não conseguem raciocinar, mas porque não existe uma camada de integração industrial entre ambos.

Nesta fase, os critérios fundamentais de avaliação não são “quanto conseguem fazer os agentes”, mas sim:

-

Conseguem evitar perder controlo em situações anómalas;

-

Conseguem manter interpretação consistente em ambientes multi-protocolo;

-

Conseguem mapear resultados de execução a alvos verificáveis;

-

Conseguem atribuir responsabilidade de risco a um mecanismo governável.

Assim, o próximo foco competitivo vai passar de “quem apresenta a melhor narrativa de agentes” para “quem completa primeiro o stack de execução fiável”.

Neste percurso, as plataformas que implementarem cenários limitados e estabelecerem loops fechados estáveis estarão melhor posicionadas para se tornarem infraestruturas de longo prazo. Produtos que dependam de narrativas de alta autonomia mas careçam de controlo de risco robusto e capacidades semânticas continuarão a enfrentar um duplo bloqueio na implementação e na confiança.

Artigos relacionados

Render, io.net e Akash: análise comparativa das redes DePIN de poder de hash

Como os Agentes de IA Impulsionarão a Cripto no Mercado Principal

Explorando o Smart Agent Hub: Sonic SVM e seu Framework de Escalonamento HyperGrid

O que são Narrativas Cripto? Principais Narrativas para 2025 (ATUALIZADO)

Visão geral das 10 melhores moedas MEME de IA